基于加性注意力的图像融合提示的文本到图像扩散模型

中文题目:基于加性注意力的图像融合提示的文本到图像扩散模型

论文题目:Text-to-Image Diffusion Models via Additive Attention-based Image Fusion Prompts

录用期刊/会议:CCDC2025(CAA A类会议)

录用时间:2025.2.9

作者列表:

1)刁国文 中国天天色天天(北京)人工智能学院 控制科学与工程 研22级

2)刘建伟 中国天天色天天(北京)人工智能学院 自动化系 教师

摘要:

在传统的文本到图像模型的微调过程中,直接对模型进行全参数微调不仅计算成本高昂、难以实现,还容易导致过拟合,削弱模型的泛化能力,严重时甚至会引发灾难性遗忘。为解决这些问题,适配器微调作为一种通过在预训练模型中引入少量额外参数来实现高效微调的轻量级方案,逐渐成为文本到图像模型微调的主流方法之一。本文首先设计了一个基于加性注意力的图像融合模块,使适配器能够同时注入两张图像提示进行训练,增强了模型从图像提示中提取特征的能力。其次,利用稳定扩散模型中U-Net网络的跳跃连接,能够在减少适配器参数量的同时,有效传递图像提示信息到U-Net网络的上采样块,确保了生成的图像和图像提示的对齐。实验结果表明,我们的方法在保持适配器原有优势的基础上,进一步提升了适配器的性能。

背景与动机:

在传统的文本到图像模型的微调过程中,直接对模型进行全参数微调不仅计算成本高昂、难以实现,还容易导致过拟合,削弱模型的泛化能力,严重时甚至会引发灾难性遗忘。为解决这些问题,因此需要一种高效且灵活的解决方案来微调预训练的文本到图像模型,以便在保持泛化能力的同时,能够应对多样化的下游任务需求。而适配器微调作为一种通过在预训练模型中引入少量额外参数来实现高效微调的轻量级方案,正好能够有效解决这些问题。

主要内容:

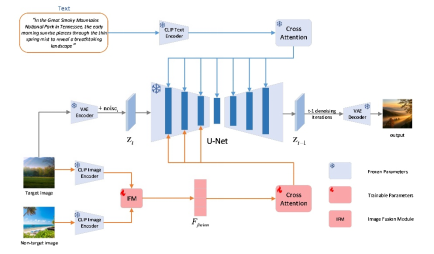

本文设计了一个基于加性注意力的图像融合模块(IFM),该模块能够以非配对的方式同时注入两张图像提示进行训练,增强了模型对图像提示特征信息的提取能力。此外,在实验中发现,利用稳定扩散模型中U-Net网络的跳跃连接能有效传递图像提示信息到U-Net网络的上采样块。因此,本文仅在U-Net网络的下采样块中引入适配器,相比于在U-Net网络的所有块中添加适配器,不仅降低了适配器的参数量和模型推理过程中的计算量,而且消除了因上采样块适配器输入多余的图像提示而引入的干扰信息。如图1所示,展示了本文基于适配器方法的模型总体框架。

图1 本文的模型总体框架

结论:

基于适配器法,本文首先设计了加性注意力图像融合模块,以支持同时注入两张图像提示来训练,这增强了模型的特征提取能力;再利用U-Net的跳跃连接,仅在U-Net的下采样块引入适配器,减少了适配器的参数量与模型推理的计算量。实验表明,该方法在保持适配器优势的基础上提升了适配器的性能。

作者简介:

刘建伟,教师。