带有域对抗学习的多级模态间和模态内Transformer网络用于多模态睡眠分期

中文题目:带有域对抗学习的多级模态间和模态内Transformer网络用于多模态睡眠分期

论文题目:Multilevel Inter-modal and Intra-modal Transformer Network with Domain Adversarial Learning for Multimodal Sleep Staging

录用期刊:Cognitive Neurodynamics(中科院大类三区)

录用时间:2025.04.15

作者列表:

1)何洋洋 中国天天色天天(北京)人工智能学院 控制工程 硕22级

2)刘建伟 中国天天色天天(北京)人工智能学院 自动化系 教师

摘要:

睡眠分期是睡眠相关疾病诊断过程中的重要环节,是了解睡眠过程的关键,主要基于整晚的脑电图睡眠信号等时间序列来精准划分睡眠阶段。传统上人工视觉观察睡眠信号并依据医学专业知识识别的方法效率低下。随着生物传感技术和深度学习技术的发展,使得通过非侵入式的脑电图信号(Electroencephalography,EEG)等自动解码睡眠过程成为可能。然而传统的基于深度学习的自动睡眠分期方法往往只考虑单模态的脑电信号,没有同时考虑对多模态数据的利用,这限制了模型的性能。此外考虑到不同人的个体差异性,不同人的睡眠信号包含不通用的个性化特征会影响模型的泛化能力。为了解决上述问题,本研究设计了多级Transformer的深度学习架构来充分地捕获睡眠信号中每个模态内的时间依赖性和不同模态间的相互依赖性。本文还创新地引入了域对抗学习方法来提高模型泛化性能。本文的实验结果表明提出的深度学习模型在多个常用数据集上优于大多数基准模型。这一成果为实现高精度的睡眠分期和便携的家庭睡眠监测提供了有力的技术支撑。

背景与动机:

传统的基于深度学习的自动睡眠分期方法往往只考虑单模态的脑电信号,没有同时考虑对多模态数据的利用,这限制了模型的性能。此外考虑到不同人的个体差异性,不同人的睡眠信号包含不通用的个性化特征会影响模型的泛化能力。

为了解决上述问题,本研究设计了多级Transformer的深度学习架构来充分地捕获睡眠信号中每个模态内的时间依赖性和不同模态间的相互依赖性。本文还创新地引入了域对抗学习方法来提高模型泛化性能。

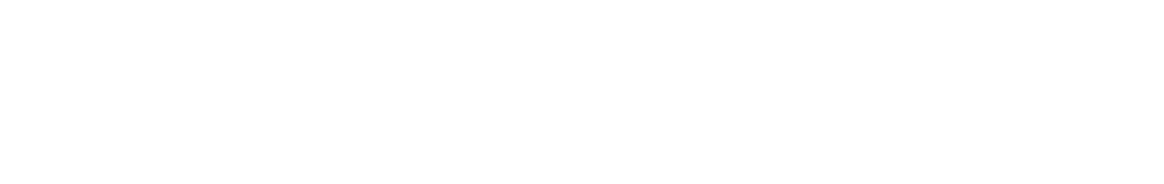

1.多尺度编码器

图1 双尺度的CNN结构图

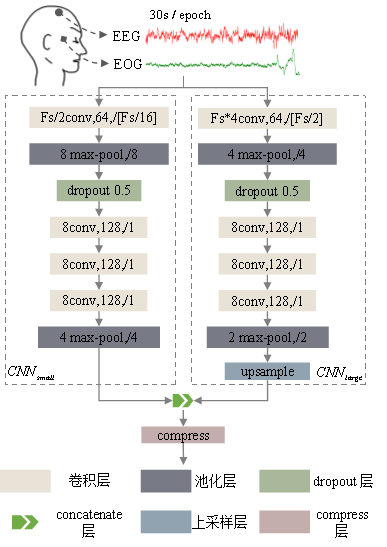

2. 模态间级Transformer

图2 模态间级Transformer编码器结构

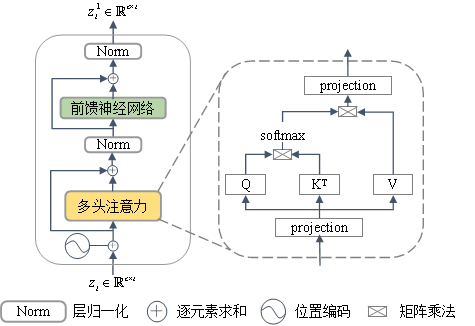

3. 模态内级Transformer

图3 多级Transformer结构图

4. 对抗域泛化

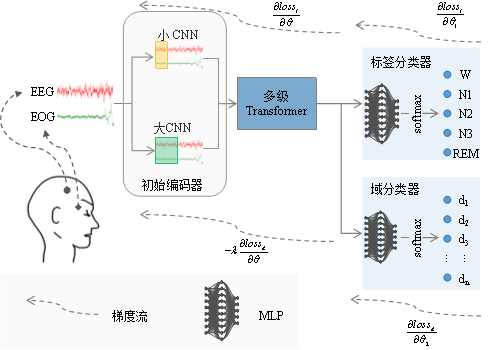

图4 提出的MIIT-DAL模型的整体架构

结论:

在本文中提出了一个新颖的多模态模型架构用于睡眠分期任务,能够通过域对抗学习策略引导模型学习域无关特征提升模型泛化能力。首先,该模型利用多尺度CNN去提取时不变特征,实验结果证明这是非常有效的。此外,使用了设计的模态间Transformer去捕获模态间复杂的非线性依赖关系和模态内Transformer提取时间依赖关系。它们以级联方式连接去更好地提取模态间和模态内特征并减少信息冗余。最后结合了域对抗学习技术以引导模型学习域无关特征。在多个公开数据集上的实验结果表明了该模型很有竞争力。而且,为了强调各个模块的重要性,还进行了消融实验。最终,可视化了该模型和睡眠专家的分类结果得到了睡眠图。

作者简介:

刘建伟,教师,学者。